Otonom Silah Sistemleri (LAWS): Savaşın Üçüncü Devrimi

Bir savaş meydanında, askerin tetiği çekmeden önce yaşadığı o anlık tereddüt, insanlığın ve vicdanın son kalesidir. Düşmanın teslim olduğunu görmek veya sivil olabileceğini düşünmek, namlunun yönünü değiştirebilir. Peki, tetiği bir insan değil de, saniyede milyonlarca veriyi işleyen, yorulmayan, korkmayan ve en önemlisi “vicdanı olmayan” bir kod satırı çekerse ne olur?

Hoş geldiniz, savaş tarihinin barut ve nükleer silahtan sonraki üçüncü büyük devrimine: Otonom Silah Sistemleri (LAWS).

Tetiği Kim Çekiyor?

Bugün sıkça duyduğumuz İHA’lar veya SİHA’lar ile karıştırmayalım. Mevcut sistemlerde, otonom uçuş özellikleri olsa bile, “ateş et” emrini veren nihayetinde bir operatördür. Buna askeri literatürde “Human-in-the-loop” (Döngüde insan var) denir.

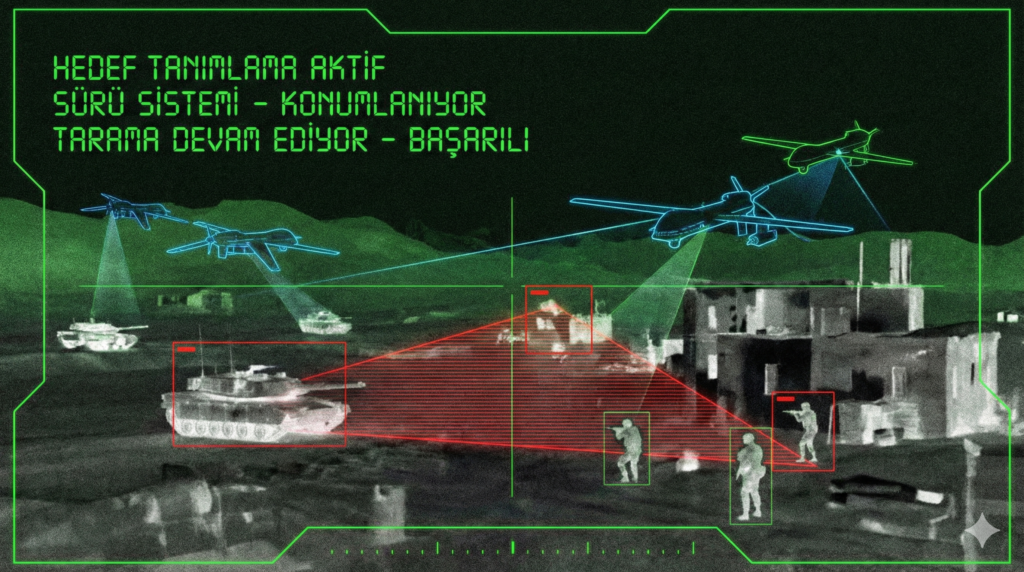

Ancak LAWS teknolojisi, insanı bu döngüden çıkarıyor. Yapay zeka algoritmaları, sensörlerden gelen veriyi işliyor, hedefi tanımlıyor (yüz tanıma, ısı haritası, davranış analizi) ve saldırı kararını kendi başına veriyor. Bu sistemler, biyolojik bir pilotun veya askerin tepki veremeyeceği kadar hızlı kararlar alabiliyor. Buna da “Hyperwar” (Hiper Savaş) deniyor.

Sürü Zekası ve “Flash War” Riski

Tek bir otonom robottan daha korkutucu olan şey, onların “sürü” (swarm) halinde hareket etmesidir. Doğadaki kuş veya arı sürülerini taklit eden bu algoritmalar, birbirleriyle haberleşerek savunma sistemlerini saniyeler içinde alt edebilir.

Ancak buradaki en büyük risk teknik arızalar değil, algoritmik tırmanmadır. İki düşman ülkenin otonom sistemleri karşılaştığında, bir tarafın savunma manevrasını diğer taraf “saldırı hazırlığı” olarak algılayabilir. Milisaniyeler içinde gerçekleşen bu veri alışverişi, insanlar daha ne olduğunu bile anlamadan topyekûn bir savaşı tetikleyebilir. Borsalarda yaşanan “Flash Crash” olaylarının, savaş sahasında yaşandığını hayal edin. Sonuçları sadece para kaybı olmayacaktır.

Cenevre’de Soğuk Rüzgarlar

Birleşmiş Milletler çatısı altında, “Katil Robotların” yasaklanması için yıllardır süren diplomatik girişimler var. İnsan Hakları İzleme Örgütü (HRW) gibi kurumlar, ölüm kalım kararının asla bir algoritmaya bırakılamayacağını savunuyor. Ancak ABD, Çin, Rusya ve İsrail gibi askeri süper güçler, bu teknolojiyi yasaklayan bağlayıcı bir anlaşmaya yanaşmıyor. Argümanları ise şu: “Otonom sistemler daha hassas vuruş yapar, sivil kayıplarını azaltır.”

Sonuç: Pandora’nın Kutusu Açıldı mı?

Otonom silah sistemleri LAWS, sadece askeri bir teknoloji değil, derin bir etik sınavdır. Sorumluluk kimde olacak? Hatalı bir vuruşta yazılımcı mı, komutan mı, yoksa makine mi yargılanacak? Teknoloji geliştikçe savaşın maliyeti (insan hayatı açısından) düşüyor gibi görünse de, savaş başlatmanın eşiği de tehlikeli bir şekilde alçalıyor. Tetiği yapay zekaya emanet etmeye hazır olup olmadığımız sorusu, cevabını savaş alanlarında değil, vicdanlarımızda aramamızı gerektiriyor.